Neste tutorial do Hadoop de big data , forneceremos uma descrição detalhada do bloco de dados Hadoop HDFS. Em primeiro lugar, abordaremos o que é bloco de dados no Hadoop, qual é sua importância, por que o tamanho dos blocos de dados HDFS é de 128 MB.

Também discutiremos o exemplo de blocos de dados no Hadoop e várias vantagens do HDFS no Hadoop.

Introdução ao bloco de dados HDFS

Hadoop HDFS divida arquivos grandes em pequenos pedaços conhecidos como Blocos . Bloco é a representação física dos dados. Ele contém uma quantidade mínima de dados que podem ser lidos ou gravados. O HDFS armazena cada arquivo como blocos. O cliente HDFS não tem nenhum controle sobre o bloco, como a localização do bloco, o Namenode decide todas essas coisas.

Por padrão, o tamanho do bloco HDFS é 128 MB que você pode alterar de acordo com sua exigência. Todos os blocos HDFS são do mesmo tamanho, exceto o último bloco, que pode ser do mesmo tamanho ou menor.

A estrutura do Hadoop divide os arquivos em blocos de 128 MB e, em seguida, armazena no sistema de arquivos do Hadoop. O aplicativo Apache Hadoop é responsável por distribuir o bloco de dados em vários nós.

Exemplo-

Suponha que o tamanho do arquivo seja de 513 MB e estamos usando a configuração padrão de tamanho de bloco de 128 MB. Em seguida, a estrutura do Hadoop criará 5 blocos, os primeiros quatro blocos de 128 MB, mas o último bloco será de apenas 1 MB.

Portanto, no exemplo, fica claro que não é necessário que no HDFS cada arquivo armazenado seja um múltiplo exato do tamanho do bloco configurado de 128 MB, 256 MB etc. Portanto, o bloco final do arquivo usa apenas o espaço necessário.

Por que o tamanho do bloco HDFS é de 128 MB?

O HDFS armazena terabytes e petabytes de dados. Se o tamanho do bloco HDFS for 4kb como o sistema de arquivos Linux, teremos muitos blocos de dados no Hadoop HDFS, portanto, muitos metadados.

Portanto, manter e gerenciar esse grande número de blocos e metadados criará uma enorme sobrecarga e tráfego, algo que não queremos.

O tamanho do bloco não pode ser tão grande que o sistema espere muito tempo para que uma última unidade de processamento de dados termine seu trabalho.

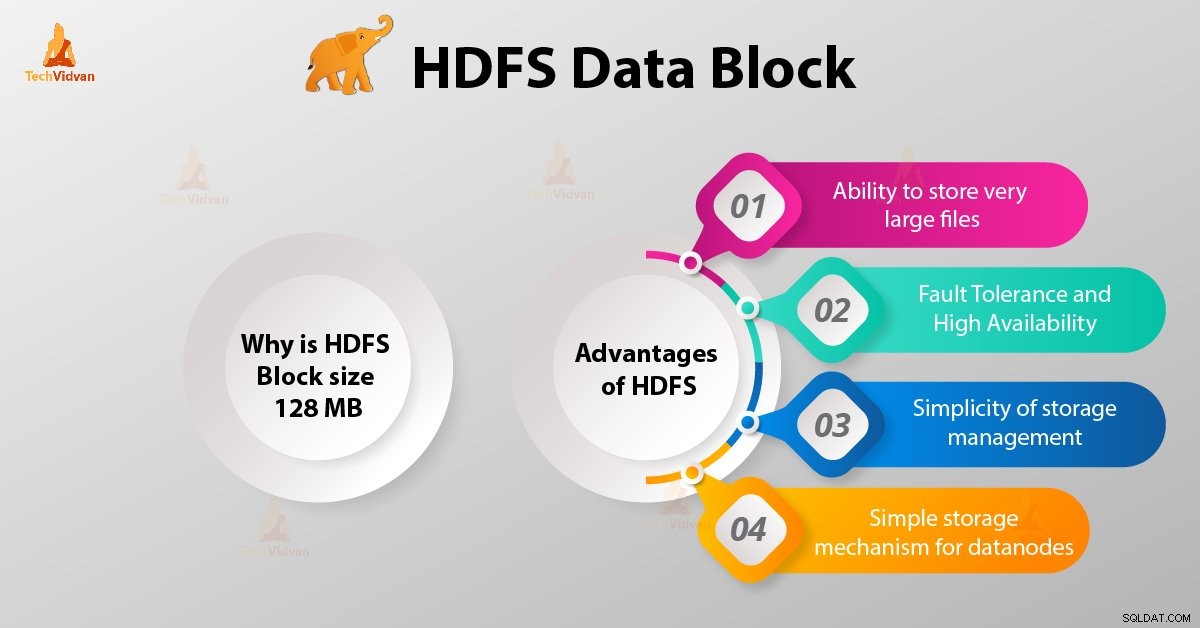

Vantagens do HDFS

Depois de aprender o que é o HDFS Data Block, vamos agora discutir as vantagens do Hadoop HDFS.

1. Capacidade de armazenar arquivos muito grandes

O Hadoop HDFS armazena arquivos muito grandes que são ainda maiores do que o tamanho de um único disco, pois a estrutura do Hadoop divide o arquivo em blocos e distribui em vários nós.

2. Tolerância a falhas e alta disponibilidade do HDFS

A estrutura do Hadoop pode replicar facilmente os blocos entre os datanodes. Assim, forneça tolerância a falhas e alta disponibilidade HDFS.

3. Simplicidade de gerenciamento de armazenamento

Como o HDFS possui tamanho de bloco fixo (128 MB), é muito fácil calcular o número de blocos que podem ser armazenados no disco.

4. Mecanismo de armazenamento simples para datanodes

Block in HDFS simplifica o armazenamento dos Datanodes . Namenode mantém metadados de todos os blocos. O HDFS Datanode não precisa se preocupar com os metadados do bloco, como permissões de arquivo, etc.

Conclusão

Portanto, o bloco de dados HDFS é a menor unidade de dados em um sistema de arquivos. O tamanho padrão do bloco HDFS é de 128 MB, que você pode configurar conforme a necessidade. Os blocos HDFS são fáceis de replicar entre os datanodes. Portanto, forneça tolerância a falhas e alta disponibilidade de HDFS.

Para qualquer consulta ou sugestão relacionada aos blocos de dados do Hadoop HDFS, informe-nos deixando um comentário em uma seção abaixo.